En 2025, la conversación sobre Inteligencia Artificial en la educación ha superado el pánico táctico. Ya no se trata de si un estudiante podría usar ChatGPT para un ensayo. La IA no es una herramienta tecnológica emergente; es el nuevo imperativo económico y un desafío de gobernanza estructural.

Para los líderes educativos, rectores y directores de innovación en Centroamérica, esto ha creado una tensión estratégica casi insostenible, un «Doble Imperativo». Por un lado, existe la presión de adoptar la IA para mantener la relevancia y la eficiencia; por el otro, el miedo paralizante a los riesgos éticos, de ciberseguridad y de implementación.

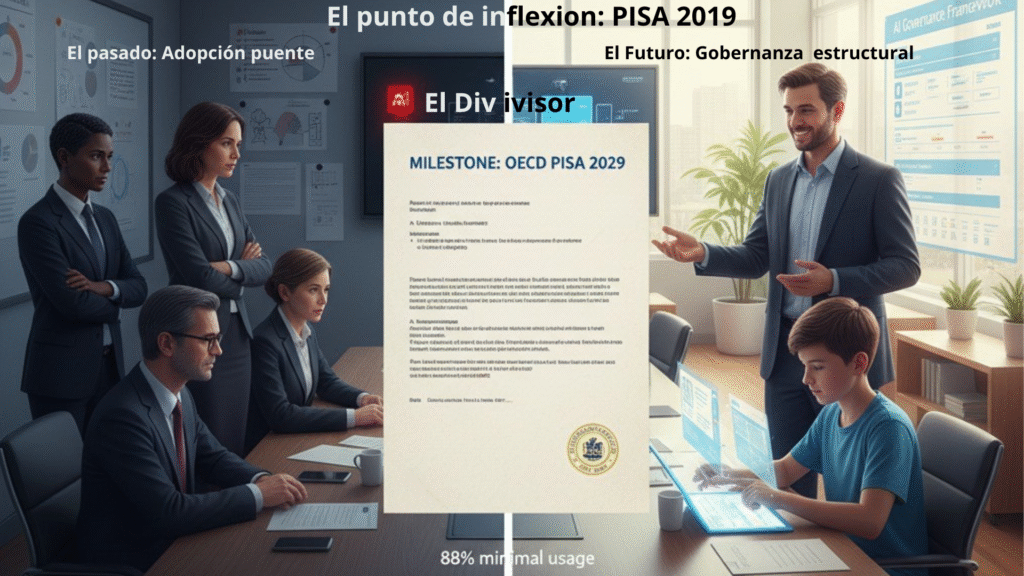

El resultado de esta parálisis es una «adopción prudente» , y los datos son contundentes: una encuesta reciente en 52 instituciones de educación superior reveló que un abrumador 88% del profesorado reporta un uso «mínimo a moderado» de la IA.

Este no es un fracaso del profesorado. Es un síntoma de un vacío de liderazgo.

Este artículo no es un análisis de tendencias más. Es una hoja de ruta estratégica. Utilizando el análisis de «El Estado de la Inteligencia Artificial 2025», demostraremos por qué el verdadero riesgo de la IA no es la adopción, sino la obsolescencia, y cómo la decisión de la OCDE sobre PISA 2029 ha cambiado las reglas del juego para siempre.

El Problema: El «Doble Imperativo» de la IA en la Educación

El liderazgo en la educación superior se encuentra atrapado entre dos fuerzas opuestas que definen el «Doble Imperativo» de 2025.

1. El Imperativo de Adopción (El Riesgo de Estancamiento)

La presión para innovar no es opcional. El Banco Mundial ha advertido en 2024 que las naciones (y, por extensión, las instituciones) que no logren adoptar la IA rápidamente corren el riesgo de «estancamiento», quedando «atrapados como exportadores de productos básicos».

En la economía del conocimiento, el «producto básico» es la educación genérica y no personalizada. Mientras las instituciones competidoras usan IA para crear trayectorias de aprendizaje personalizadas y predecir tasas de abandono , las que se aferran a los modelos tradicionales corren el riesgo de ofrecer un producto obsoleto.

2. El Imperativo de Gobernanza (El Riesgo de Implementación)

La contraparte de esta presión es la necesidad de una implementación controlada. La IA introduce «vulnerabilidades» críticas. Un informe de la consultora Marsh sobre Latinoamérica identificó que el 70% de los líderes empresariales considera que aumentarán los ataques relacionados con el abuso de tecnologías emergentes, principalmente la IA.

Para las universidades, esto se traduce en riesgos ético-legales, brechas de ciberseguridad y una profunda incertidumbre sobre la privacidad de los datos de los estudiantes.

La Manifestación en la Academia: La Parálisis del 88%

Este «Doble Imperativo» —innovar para sobrevivir, pero con miedo a los riesgos— crea un vacío de gobernanza. Y en este vacío, el personal de primera línea (el profesorado) reacciona racionalmente: no hacen nada.

El dato de que el 88% del profesorado muestra un uso «mínimo a moderado» no es un indicador de pereza o tecnofobia. Es el síntoma más claro de un fracaso de liderazgo. Es una «adopción prudente» por parte de individuos que se sienten expuestos, sin un marco estratégico, ético o técnico que los proteja a ellos o a sus estudiantes.

El problema, por tanto, no se resuelve con «más cursos de ChatGPT». Se resuelve con una «gobernanza estructural».

La Agitación: El «Desfase Estratégico» y el Riesgo de Obsolescencia

Si el problema es la parálisis, la agitación es el costo de esa inacción. El verdadero riesgo de la IA para las instituciones educativas no es el plagio estudiantil. El verdadero riesgo es la obsolescencia institucional.

Para entender esta amenaza, utilicemos una poderosa narrativa de la región: el caso de Panamá.

Un análisis de noviembre de 2025 advierte que la posición de Panamá como hub logístico y bancario regional está directamente amenazada por su «lenta integración» de la IA. La ventaja competitiva de Panamá no es un recurso natural; es la eficiencia de sus servicios (el Canal, su centro bancario). La IA es una tecnología que ataca y optimiza fundamentalmente ese pilar de eficiencia.

Su institución educativa es ahora Panamá.

El «Canal» de su universidad es su eficiencia en los servicios académicos: la acreditación, la gestión de matrículas, la investigación, la retención de estudiantes y la reputación de su marca. La IA está optimizando radicalmente cada uno de esos servicios en otras instituciones.

El análisis sobre Panamá introduce un término que debería resonar en cada rectorado: la «lenta integración» de la IA ya no es un problema tecnológico, se ha convertido en un nuevo vector de «riesgo soberano». El riesgo de que la base misma de su modelo económico se vuelva irrelevante.

El término para esta amenaza es obsolescencia tecnológica.

La «vulnerabilidad central» que enfrenta Panamá, y que enfrentan las universidades, se define como el «desfase estratégico». Esta es la brecha crítica entre:

La Velocidad del Riesgo: Impulsada por el mercado, donde los competidores globales adoptan la IA.

La Velocidad de la Burocracia: Impulsada por los ciclos políticos y académicos, que se mueven con lentitud.

Mientras el sector bancario panameño debate la implementación, sus competidores globales ya la están usando. Mientras su universidad «evalúa el ecosistema» (la primera fase de la estrategia panameña ), sus competidores globales están prediciendo activamente qué estudiantes están en riesgo de abandonar y generando trayectorias académicas personalizadas para retenerlos.

Esta parálisis se debe al «principal cuello de botella» para la implementación de la IA: no es tecnológico, es humano. Es un «déficit en la gestión del cambio organizacional» y una «falta de alfabetización en IA en la fuerza laboral».

La Solución (Parte 1): De la Herramienta a la Gobernanza Estructural

La salida a esta parálisis no es una nueva herramienta de software. Es un nuevo modelo mental. La solución al «Doble Imperativo» es adoptar el gran pivote estratégico de 2025: el mundo está pasando de debatir «principios éticos» abstractos a construir una «arquitectura de gobernanza» concreta.

El «salvaje oeste» de la IA está terminando. Los gigantes de la industria y los organismos globales están definiendo las reglas del juego.

1. El Hito que lo Cambia Todo: La OCDE y PISA 2029

El movimiento más significativo que definirá la próxima década de la educación proviene de la Organización para la Cooperación y el Desarrollo Económicos (OCDE).

La OCDE ha decidido incluir la «Alfabetización en Medios e Inteligencia Artificial» (MAIL) en su evaluación PISA 2029.

El impacto de esta decisión no puede subestimarse. PISA evalúa las competencias que un joven de 15 años necesita para funcionar eficazmente en la sociedad. Al añadir la IA a esta evaluación, la OCDE está declarando formalmente que la IA ya no es una habilidad técnica especializada para ingenieros, sino una «competencia cívica fundamental» para todos los ciudadanos.

Esto cambia radicalmente la misión de la educación superior:

Mata el Debate: El debate de «¿Deberíamos permitir IA en el aula?» está oficialmente muerto. La OCDE ha zanjado la cuestión. Como señala la UNESCO, negar esta alfabetización es negar el «derecho a la educación» en la era digital.

Redefine la Admisión: Los estudiantes que ingresen a la universidad a partir de 2030 (la primera cohorte post-PISA 2029) esperarán que esta alfabetización esté integrada en todo el currículo, no en un taller opcional.

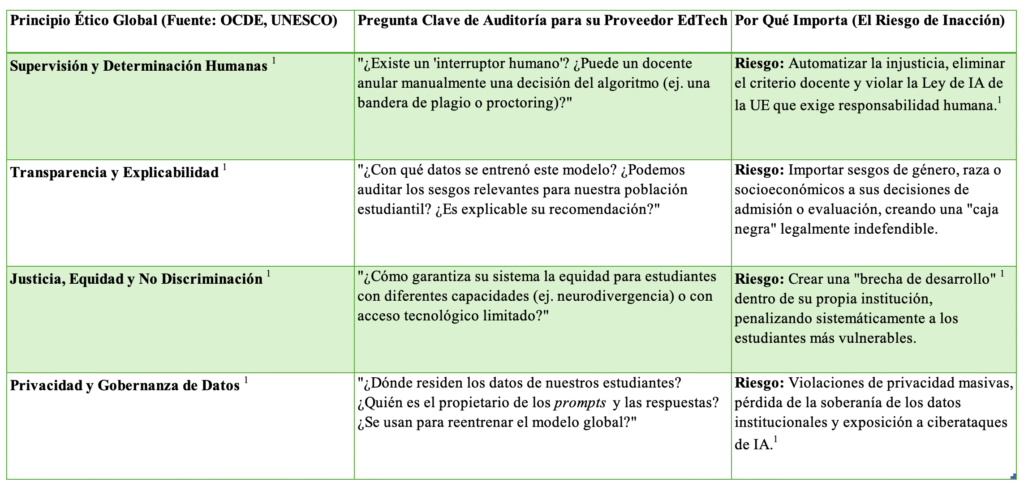

2. La Convergencia Ética: UNESCO y el Estándar Global

El miedo a los «riesgos ético-legales» es una de las principales causas de la parálisis. Sin embargo, el caos ético se está estabilizando. La «Recomendación de la UNESCO sobre la Ética de la IA» , junto con las directrices de la OMS y la OCDE, demuestran un consenso global emergente.

Los principios que ya no son opcionales, sino el estándar de oro global esperado, son:

Supervisión y Determinación Humanas

Transparencia y Explicabilidad

Equidad y No Discriminación

Privacidad y Gobernanza de Datos

El lanzamiento de nuevos paneles de gobernanza por parte de la ONU y la implementación de la Ley de IA de la UE confirman que esta arquitectura regulatoria ya no es teórica. Está aquí.

La Solución (Parte 2): La Hoja de Ruta Práctica para Líderes de EdTech

Adoptar una «arquitectura de gobernanza» permite a los líderes ir más allá del pánico superficial de ChatGPT. La verdadera transformación de la gestión educativa es «mucho más profunda».

Las instituciones líderes ya no están debatiendo sobre IA; la están implementando en operaciones centrales para «generar trayectorias académicas personalizadas», «predecir qué alumnos corren el riesgo de abandonar sus estudios» y gestionar la supervisión (proctoring) en línea a gran escala.

La pregunta es: ¿cómo pasar de la parálisis del 88% a esta implementación estratégica?

La respuesta se encuentra en los datos de la minoría activa. El estudio al profesorado reveló cómoestán usando la IA aquellos que sí la adoptan:

75% para la creación de materiales didácticos.

58% para apoyo administrativo.

Este dato es oro puro. Revela que, a falta de una estrategia institucional, los profesores están usando la IA para optimizar sus tareas (eficiencia personal), no para transformar el aprendizaje del estudiante(reinvención pedagógica). Es la prueba definitiva del «déficit en la gestión del cambio».

Para cerrar esta brecha, los líderes (Rectores, Decanos, CEOs de EdTech) deben ejecutar una estrategia de «Gobernanza Primero» en tres acciones clave, adaptadas de las recomendaciones de alto nivel del análisis de 2025 :

Acción 1: Invertir en Personas, no solo en Tecnología

El presupuesto de IA no debe ir a «comprar licencias», sino a resolver el «cuello de botella humano». El principal obstáculo para integrar la IA en la práctica clínica, según un estudio paralelo en el sector salud, es la «falta de formación» (47.6%). El sector educativo no es diferente.

El éxito de la IA no lo determina la tecnología, sino la «capacidad de las instituciones para alinear la implementación tecnológica con el propósito humano y la confianza pública». Esto exige una inversión masiva en Gestión del Cambio, Formación y Alfabetización en IA para toda la fuerza laboral, desde el rectorado hasta el profesor adjunto.

Acción 2: Liderar la «Batalla de las Metáforas»

Los líderes deben comunicar proactivamente el propósito de la IA en la institución. No se puede permitir que la tecnología se defina por defecto (como «magia») o por el pánico (como «reemplazo»).

La dirección debe articular la visión: «La IA se usará para aumentar el juicio del docente, no para reemplazarlo«. El objetivo estratégico es preservar el «criterio humano» y la «responsabilidad humana» en todo momento.

Acción 3: Exigir «Supervisión Humana» en la Adquisición

Esta es la acción más práctica y poderosa. Al comprar o desarrollar tecnología EdTech, los líderes no deben aceptar «cajas negras».

Deben exigir a los proveedores transparencia y la incorporación de la «supervisión humana» en el centro del sistema. Específicamente, al evaluar herramientas de proctoring, admisión o evaluación , la pregunta clave para el proveedor debe ser:

«¿Puede un humano anular la decisión de la IA?»

«¿Cómo, y cuán rápido?»

«¿Con qué datos se entrenó este modelo y cómo garantizan que no discrimina a nuestra población estudiantil?»

Matriz de Auditoría Ética de IA para Líderes de EdTech

Para transformar estos principios en acción, los líderes deben auditar a sus proveedores. Esta matriz traduce los principios de gobernanza global en las preguntas clave que todo rector debe hacer antes de firmar un contrato.

Conclusión: Su Próximo Paso Hacia la «Gobernanza Estructural»

El viaje ha quedado claro. El «Doble Imperativo» está paralizando a las instituciones, como lo demuestra la «adopción prudente» del 88% del profesorado. El miedo a este estancamiento se ve intensificado por el riesgo real de «obsolescencia tecnológica».

La solución no es una herramienta, sino un marco de «gobernanza estructural» , un estándar que ya está siendo definido por gigantes globales como la OCDE con su histórica decisión sobre PISA 2029.

El futuro de la educación no pertenecerá a quien adopte la IA más rápido, sino a quien la gobierne más sabiamente. La pregunta para los líderes de la Academia Centroamericana de Ingenio y sus instituciones aliadas no es «¿Qué IA comprar?», sino «¿Qué marco de gobernanza vamos a construir para proteger y potenciar nuestro propósito humano?».

El Activo de Valor: Su Checklist de Auditoría

Este artículo es el Por Qué. El siguiente paso es el Cómo.

Hemos proporcionado un valor inmenso de forma gratuita para ayudar a enmarcar el desafío estratégico. Como siguiente paso, ofrecemos una herramienta complementaria para ayudarle a aplicareste conocimiento.

Descargue nuestro recurso exclusivo y gratuito: «El Checklist de 15 Preguntas de Auditoría de IA para Líderes Educativos».

Este content upgrade no es un boletín genérico; es una herramienta práctica diseñada para que la lleve a su próxima reunión con un proveedor de tecnología y garantice que su institución esté construyendo sobre roca, no sobre arena.

Obras citadas:

- Content Marketing: how to create posts that sell without seeming like you’re selling, fecha de acceso: octubre 21, 2025, https://brief.pt/2025/08/content-marketing-how-to-create-posts-that-sell-without-seeming-like-youre-selling/

- How a Value-Focused, Serve-First Marketing Approach is the Best Approach For Today & Tomorrow’s Smart Marketer – Express Writers, fecha de acceso: octubre 21, 2025, https://expresswriters.com/value-focused-marketing/

- What Is Content Marketing? How It Works in 2025 – WordStream, fecha de acceso: octubre 21, 2025, https://www.wordstream.com/blog/content-marketing

- Content Marketing Mastery: Creating Value Across the Customer Journey | Romain Berg, fecha de acceso: octubre 21, 2025, https://www.romainberg.com/blog/content/content-marketing-value-customer-journey/

- (PDF) Value first, then price: the new paradigm of B2B buying and selling – ResearchGate, fecha de acceso: octubre 21, 2025, https://www.researchgate.net/publication/350356732_Value_first_then_price_the_new_paradigm_of_B2B_buying_and_selling

- Content Inc – Joe Pulizzi, fecha de acceso: octubre 21, 2025, https://www.joepulizzi.com/books/content-inc/

- Contenido Evergreen – Qué es, ejemplos y cómo usarlo – Jorge Fannoun, fecha de acceso: octubre 21, 2025, https://jorgefannoun.com/contenido-evergreen/

- Inverted pyramid structure – Style Manual, fecha de acceso: octubre 21, 2025, https://www.stylemanual.gov.au/structuring-content/types-structure/inverted-pyramid-structure

- Cómo escribir una gran publicación de blog (estructura + ejemplos) – WPBeginner, fecha de acceso: octubre 21, 2025, https://www.wpbeginner.com/es/wp-tutorials/how-to-write-a-great-blog-post-structure-examples/

- Cuál es la estructura de un blog: partes y buenas prácticas – Wix, fecha de acceso: octubre 21, 2025, https://es.wix.com/blog/estructura-de-un-blog

- Ejemplo de la estructura ideal de un artículo de blog corporativo, fecha de acceso: octubre 21, 2025, https://agenciavilo.com/estructura-articulo-blog/

- Cómo escribir en un blog para crear el post perfecto. – GoDaddy Resources – Spain, fecha de acceso: octubre 21, 2025, https://www.godaddy.com/resources/es/blogs/como-escribir-en-un-blog-para-crear-el-post-perfecto

- Cómo estructurar tu post para blog para que sea fácil de leer…, fecha de acceso: octubre 21, 2025, https://neoattack.com/blog/como-estructurar-tu-post-para-blog-para-que-sea-facil-de-leer/

- Inverted pyramid (journalism) – Wikipedia, fecha de acceso: octubre 21, 2025, https://en.wikipedia.org/wiki/Inverted_pyramid_(journalism)

- First things first: writing content with the inverted pyramid style • Yoast, fecha de acceso: octubre 21, 2025, https://yoast.com/inverted-pyramid/

- How to Use The Inverted Pyramid for SEO Copywriting – Search Engine Journal, fecha de acceso: octubre 21, 2025, https://www.searchenginejournal.com/inverted-pyramid-for-seo-copywriting/406712/

- How to Use the Inverted Pyramid to Improve Web Content – AIOSEO, fecha de acceso: octubre 21, 2025, https://aioseo.com/how-to-use-the-inverted-pyramid-to-improve-web-content/

- Skyscraper Method: +110% Traffic (Link Building Case Study), fecha de acceso: octubre 21, 2025, https://backlinko.com/skyscraper-technique

- How to Use the Skyscraper Technique to Boost SEO – Elegant Themes, fecha de acceso: octubre 21, 2025, https://www.elegantthemes.com/blog/wordpress/how-to-use-the-skyscraper-technique-to-boost-seo

- The Skyscraper Technique: What Is It And Does It Still Work In 2025? | LinkBuilder.io, fecha de acceso: octubre 21, 2025, https://linkbuilder.io/skyscraper-technique/

- Backlinko: SEO, Content Marketing, & Link Building Strategies, fecha de acceso: octubre 21, 2025, https://backlinko.com/

- Skyscraper Technique for SEO: 2025 Guide – Editorial.Link, fecha de acceso: octubre 21, 2025, https://editorial.link/skyscraper-technique/

- PAS Copywriting: The Best Framework for Writing Persuasive Copy, fecha de acceso: octubre 21, 2025, https://www.jessewisnewski.co/article/pas-copywriting

- Master This Copywriting Formula to Dominate Any Social Media Platform – Copyblogger, fecha de acceso: octubre 21, 2025, https://copyblogger.com/problem-agitate-solve/

- The PAS Copywriting Formula: The Best Format for Short Form Content, fecha de acceso: octubre 21, 2025, http://www.nonprofitcopywriter.com/PAS-copywriting-formula.html

- How to Master the Problem-Agitate-Solution Copywriting Formula – BlakSheep Creative, fecha de acceso: octubre 21, 2025, https://blaksheepcreative.com/digital-marketing/content-marketing/copywriting/problem-agitate-solution-formula/

- 6 PAS Copywriting Examples Showing the Impact of Great Copy – eContentSol, fecha de acceso: octubre 21, 2025, https://econtentsol.com/blog/pas-copywriting-examples/

- educativo Storytelling – FONDEP, fecha de acceso: octubre 21, 2025, https://www.fondep.gob.pe/wp-content/uploads/2021/06/091121_CURSO-MOOC-STORYTELLING-EDICION2-v-final.pdf

- Storytelling en e-learning: ejemplos y 5 claves para aplicarlo…, fecha de acceso: octubre 21, 2025, https://www.ideaspropiaseditorial.com/blog/storytelling-en-e-learning/

- Las 7 técnicas de storytelling más utilizadas por los presentadores de Ted Talks – Visme, fecha de acceso: octubre 21, 2025, https://visme.co/blog/es/tecnicas-de-storytelling/

- Storytelling en la educación: métodos y estratégias – SMOWL, fecha de acceso: octubre 21, 2025, https://smowl.net/es/blog/storytelling-en-la-educacion/

- Estrategias de contenido evergreen: Cómo atraer tráfico constante | Seo Is – seois?, fecha de acceso: octubre 21, 2025, https://seois.co/estrategias-de-contenido-evergreen-como-atraer-trafico-constante/

- Contenido Evergreen: Qué Es, Ejemplos y Cómo Crearlo…, fecha de acceso: octubre 21, 2025, https://www.m8l.com/blog/contenido-evergreen-que-es

- Contenido evergreen: el arte de redactar contenido atemporal | Dear Content, fecha de acceso: octubre 21, 2025, https://dearcontent.com/es/contenido-evergreen/

- Five Lead Magnets that Complement Paid Traffic | Mike Raybone, fecha de acceso: octubre 21, 2025, https://www.mikeraybone.co.uk/es/five-lead-magnets-that-complement-paid-traffic/

- What is LEAD MAGNET? ▷ 7 IDEAS for your eCommerce – Doofinder, fecha de acceso: octubre 21, 2025, https://www.doofinder.com/en/blog/lead-magnet-ecommerce

- 13 Best Marketing Blogs to Follow (For Marketers of All Levels) – Ahrefs, fecha de acceso: octubre 21, 2025, https://ahrefs.com/blog/best-marketing-blogs/

- Los mejores blogs de marketing digital que debes tener en tu radar – IEBS, fecha de acceso: octubre 21, 2025, https://www.iebschool.com/hub/los-90-mejores-blogs-de-marketing-digital-que-debes-tener-en-tu-feed-marketing-digital/

- Ahrefs Blog | Get Better at SEO & Marketing, fecha de acceso: octubre 21, 2025, https://ahrefs.com/blog/

- HubSpot Blog | Marketing, Sales, Agency, and Customer Success…, fecha de acceso: octubre 21, 2025, https://blog.hubspot.com/

- Principales estrategias de distribución de contenido digital…, fecha de acceso: octubre 21, 2025, https://es.sharpspring.com/marketing/top-digital-content-distribution-strategies/

- 6 Step Content Distribution Strategy (for Maximum Reach) in 2025 – Backlinko, fecha de acceso: octubre 21, 2025, https://backlinko.com/content-distribution

- How to Build a Content Distribution Strategy That Actually Works, fecha de acceso: octubre 21, 2025, https://www.distribution.ai/blog/content-distribution-strategy

- How to Use Advanced Content Distribution Strategies to Maximize Reach and ROI, fecha de acceso: octubre 21, 2025, https://www.everywheremarketer.com/blog/content-distribution-strategies

- ¿Qué es la estrategia de contenido? Una guía paso a paso – Nationwide, fecha de acceso: octubre 21, 2025, https://espanol.nationwide.com/business/solutions-center/digital-marketing/what-is-content-strategy

- How Do You Develop an Effective Content Distribution Strategy? – Column Five, fecha de acceso: octubre 21, 2025, https://www.columnfivemedia.com/how-do-you-develop-an-effective-content-distribution-strategy/

- Content Syndication: What it is & how to do it successfully, fecha de acceso: octubre 21, 2025, https://blog.hubspot.com/marketing/how-to-syndicate-content

- 9 Métricas Esenciales de Engagement Para Sitios Web Que Debes…, fecha de acceso: octubre 21, 2025, https://blog.duda.co/es/metricas-de-engagement

- Métricas web: guía completa con 16 métricas clave para tu sitio web – Blog de HubSpot, fecha de acceso: octubre 21, 2025, https://blog.hubspot.es/website/metricas-sitio-web

- How to Track Scroll Depth in Google Analytics 4 – Semrush, fecha de acceso: octubre 21, 2025, https://www.semrush.com/blog/google-analytics-scroll-depth/

- Can You Track Scroll Depth with Google Analytics? – Blobr, fecha de acceso: octubre 21, 2025, https://www.blobr.io/how-to-guides/can-you-track-scroll-depth-with-google-analytics

- www.blobr.io, fecha de acceso: octubre 21, 2025, https://www.blobr.io/how-to-guides/can-you-track-scroll-depth-with-google-analytics#:~:text=To%20track%20scroll%20depth%20in,tracks%20scroll%20depth%20at%2090%25.

- Measuring blog engagement: Testing a four-dimensional scale – ResearchGate, fecha de acceso: octubre 21, 2025, https://www.researchgate.net/publication/232394973_Measuring_blog_engagement_Testing_a_four-dimensional_scale

- Qualitative comments analysis for deeper understanding – Insight7…, fecha de acceso: octubre 21, 2025, https://insight7.io/qualitative-comments-analysis-for-deeper-understanding/

- Elements Influencing User Engagement in Social Media Posts on Lifestyle Risk Factors: Systematic Review, fecha de acceso: octubre 21, 2025, https://pmc.ncbi.nlm.nih.gov/articles/PMC11624458/

- www.lucushost.com, fecha de acceso: octubre 21, 2025, https://www.lucushost.com/blog/autoridad-de-dominio/#:~:text=La%20Autoridad%20de%20un%20Dominio%20se%20mide%20en%20una%20escala,con%20una%20DA%20de%2020.

- Domain Authority: qué es, para qué sirve y cómo medirlo | Blog de Piensa Solutions, fecha de acceso: octubre 21, 2025, https://www.piensasolutions.com/blog/domain-authority-que-es-para-que-sirve-y-como-medirlo

- Autoridad de dominio: Qué es y cómo medirla | Blog de LucusHost, fecha de acceso: octubre 21, 2025, https://www.lucushost.com/blog/autoridad-de-dominio/

- ¿Qué es la autoridad de página? – El Blog de SEO de Dinorank, fecha de acceso: octubre 21, 2025, https://dinorank.com/blog/diccionario-seo/que-es-autoridad-de-pagina/